Förderjahr 2020 / Project Call #15 / ProjektID: 5121 / Projekt: CognitiveAR

CognitiveXR ist ein größeres Vorhaben um die neuartigen Technologien Edge Computing, AI, und Augmented Reality (AR) für EnticklerInnen leichter zugänglich zu machen. Das Netidee Projekt "CognitiveAR" kommt zum Abschluss, ist aber erst der Anfang!

Wie hat alles begonnen?

Durch die Forschungsarbeit von Dr. Thomas Rausch und Dr. Katharina Krösl, haben beide erkannt, dass sich in den Bereichen Edge Computing, Artificial Intelligence (AI), und Augmented Reality (AR), eine reichhaltige Schnittmenge an Themen autut, die jedoch sowohl für ForscherInnen als auch AR EntwicklerInnen schwer zugänglich ist. Verteilte Systeme und AI sind komplexe Technologien, die für AR EntwicklerInnen jedoch notwendig sind um interessante Anwendungsfälle umzusetzen.

Eine Hauptinspiration war das Kunstprojekt HYPER-REALITY, das einerseits die Grenze des Vorstellbaren ausgereizt hat, aber auch als Leitbild dient wie man diese Technologien verantwortungsvoll entwickeln muss, um nicht in einer dystopischen Zukunft an zu kommen. Aus dem Kunstprojekt ergab sich die Frage, wie man diese Idee ins positive wandeln könnte?

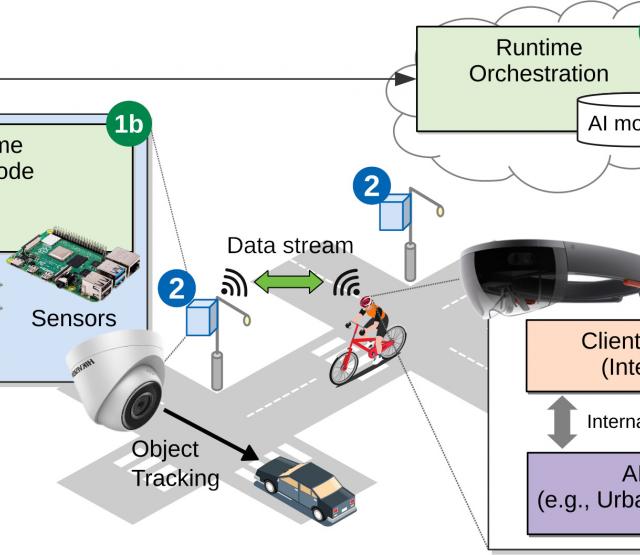

Thomas und Katharina hatten dann gemeinsam zwei Ideen. Was wäre wenn wir beim Radfahren eine AR Brille aufhaben, die uns Autos in der Umgebung anzeigt, die noch gar nicht in unserem Sichtfeld sind? Das würde doch die Sicherheit im Straßenverkehr verbessern, und die positiven Aspekte dieser Technologien aufzeigen?! Oder stellen wir uns vor wir könnten Menschen mit eingeschränkten kognitiven Fähigkeiten helfen, die Emotionen von Gesprächspartnern zu interpretieren!

Aus diesen simplen Ideen wurden die ersten Anforderungen für CognitiveAR erarbeitet.

Was hat das Netidee Projekt gebracht?

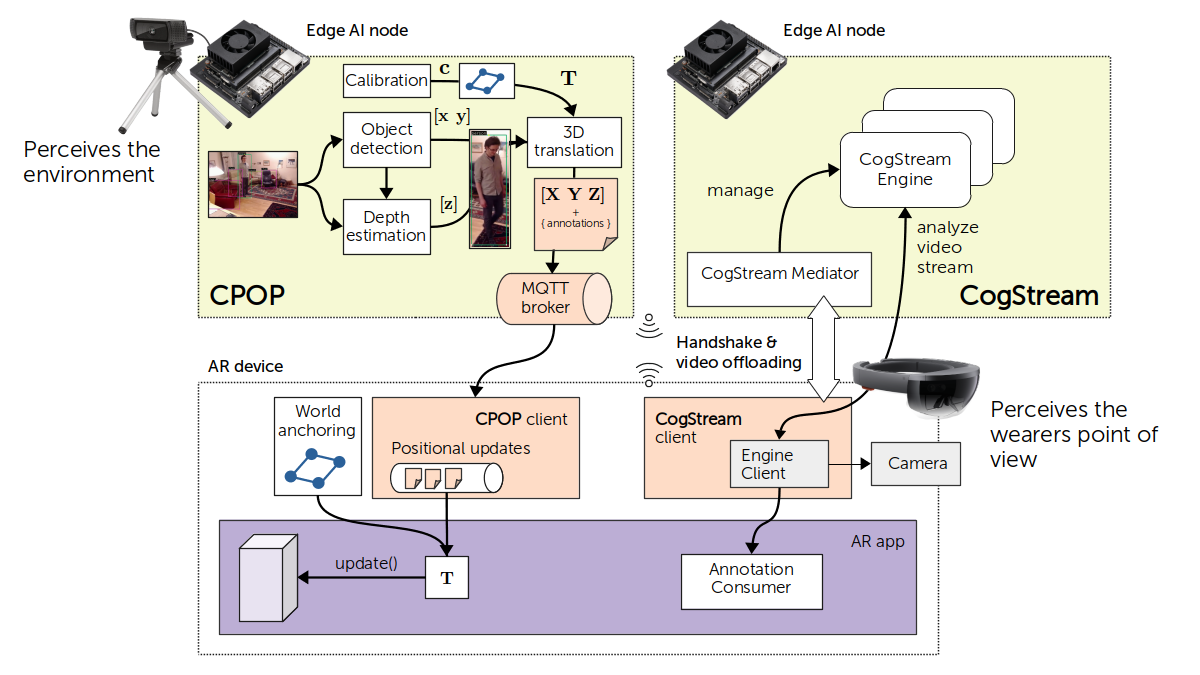

Solche und Ähnliche Anwendungsfälle die AR Brillen im urbanen Raum einsetzen, haben zwei Kernanforderungen. Erstens müssen Sensordaten aus der Umgebung, wie etwa die Position von Fußgängern oder Autos in Echtzeit an AR Geräte übertragen werden. Zweitens müssen AR Geräte in der Lage sein komplexe Analyseaufgaben auf dem Videofeed der Brillen selbst aus zu führen. Jedoch ist dies am Gerät oft nicht möglich, wegen der reduzierten Rechnerkapazität. Es ist daher notwendig, den Videofeed an umliegende Infrastruktur zu senden, die mit der notwendigen Hardwarebeschleunigung Berechnungen durchführen kann (z.B. das erkennen von Gesichtern und deren Interpretation).

Der Fokus des Projekts war es daher zu demonstrieren, dass diese Anforderungen mit den uns zur verfügung stehenden Technologien erfüllbar sind. Die folgende Darstellung zeigt die Projektergebnisse, und was sich mit unserer Plattform machen lässt.

Eine vollständige Demonstration inklusive videos findet sich hier: https://github.com/cognitivexr/cognitivear-demo

Wie geht es weiter?

Wir werden nähern uns mit großen Schritten einer Zukunft in der Extended Reality (XR) ein Teil unseres Alltags sein wird, wie jetzt schon das Smartphone. Mit den aktuellen Enticklungen in diesem Bereich wird gibt es immer mehr Bedarf an Lösungen um Edge Computing, AR und AI zu vereinen.

Unsere Plattform erlaubt es AR EntwicklerInnen schneller mit Edge Computing und AI los zu legen um Ihre Anwendungen um zu setzen. So könnte man rasch eine Anwendung für eine AR Brille entwickeln, die Gebärdensprache visuell interpretiert und eine Übersetzung davon auf dem Display der Brille anzeigt.

Viele Ideen für den urbanen Raum müssen mit Outdoor Technologien umgesetzt werden. Diese sind viel schwerer umzusetzen. Einerseits sind Kameras für das Erkennen von Objekten im öffentlichen Raum höchst Problematisch, andererseits gibt es auch schwierigkeiten AI Modelle zu finden die für solche Umgebungen gut funktionieren. Außerdem sind unsere Hardware Prototypen aktuell nicht für den Outdoor Betrieb konzipiert.

Wir werden weiter an diesen spannenden Themen arbeiten, und laden sowohl ForscherInnen als auch EntwicklerInnen ein unsere Plattform zu testen und eigene Anwendungen damit um zu setzen!